Yapay zeka teknolojileri, son yıllarda yalnızca özel sektörün değil, sivil toplumun da çalışma biçimlerini köklü biçimde dönüştürmeye başlamıştır. Veri analizi, hedef kitleye erişim, savunuculuk kampanyalarının tasarımı, içerik üretimi ve karar destek süreçleri gibi pek çok alanda yapay zeka araçları, sivil toplum örgütlerine (STÖ) önemli fırsatlar sunmaktadır. Ancak bu teknolojilerin sunduğu kapasite artışı, beraberinde ciddi etik sorumlulukları da getirmektedir.

İnsan hakları, adalet, eşitlik, şeffaflık ve hesap verebilirlik gibi sivil toplumun temelinde yer alan değerler, yapay zeka kullanımında daha da kritik hale gelmektedir. Çünkü yapay zeka sistemleri yalnızca teknik araçlar değildir; aynı zamanda veri üzerinden öğrenen, kararları etkileyen ve toplumsal sonuçlar üreten sosyo-teknik yapılardır. Bu nedenle, bir yapay zeka uygulamasının “işe yarıyor” olması, onun “doğru” veya “adil” olduğu anlamına gelmez.

Özellikle dezavantajlı gruplarla çalışan, kırılgan topluluklara hizmet sunan veya hak temelli savunuculuk yürüten STÖ’ler için yapay zeka kullanımı daha yüksek bir dikkat ve özen gerektirir. Algoritmik önyargılar, veri mahremiyeti ihlalleri, yanlış veya yanıltıcı içerik üretimi ve otomatik karar süreçlerinin şeffaf olmaması gibi riskler, doğrudan bu grupların yaşamlarını etkileyebilir. Bu bağlamda, “zarar vermeme” ilkesi, yapay zeka kullanımında soyut bir etik ilke olmaktan çıkıp somut bir operasyonel gereklilik haline gelmektedir.

Bu rehber, sivil toplum kuruluşlarının yapay zeka teknolojilerini yalnızca etkili değil, aynı zamanda etik ve sorumlu bir şekilde kullanmalarını desteklemek amacıyla hazırlanmıştır. Amacı, teknik detaylara boğulmadan; STÖ çalışanlarına yapay zeka etiği konusunda bir çerçeve sunmaktır. Bu çerçeve; farkındalık, risk değerlendirmesi, şeffaflık, hesap verebilirlik ve insan odaklılık gibi temel ilkeler etrafında şekillenmektedir.

Temel Kavramlar

Yapay Zeka Etiği ve Sorumlu Yaklaşım: Yapay zeka, sivil toplumda salt verimlilik aracı değil, insan onuru, adalet ve kapsayıcılık gibi etik ilkeleri merkeze alan sorumlu bir yaklaşımla kullanılmalıdır.

Algoritmik Önyargı: Yapay zeka sistemleri, eğitildikleri verilerdeki tarihsel eşitsizlikleri yeniden üreterek sosyal yardım veya işe alım gibi alanlarda ayrımcılığa yol açabilir ve risk oluşturabilir.

Açıklanabilirlik ve Kara Kutu Sorunu: Bir yapay zeka kararının “neden” verildiği anlaşılır olmalıdır; şeffaflık, özellikle hak temelli başvurularda hesap verebilirlik ve itiraz hakkının temelini oluşturur.

İnsan Denetimi: Yapay zeka bir karar verici değil, karar destek aracıdır; nihai sorumluluk, otomasyon yanlılığı riskine karşı sistemi denetleyebilen yetkin bir insanda kalmalıdır.

Veri Gizliliği ve Mahremiyet: Kişisel verilerin toplanması ve işlenmesi, özellikle hassas gruplarla çalışırken rıza, amaçla sınırlılık ve veri minimizasyonu ilkeleriyle hak temelli bir sorumluluk olarak yönetilmelidir.

Halüsinasyonlar ve Doğrulama: Üretken yapay zeka, doğru gibi görünen ancak yanlış bilgiler üretebilir, bu nedenle sivil toplum iletişiminde tüm çıktıların insan tarafından doğrulanması kritik bir güvenlik adımıdır.

Yönetişim ve Politika Oluşturma: STK’lar, yapay zeka kullanım sınırlarını, etik standartları ve denetim mekanizmalarını belirleyen yazılı politikalar oluşturarak riskleri yönetmeli ve sorumlu bir çerçeve kurmalıdır.

Bütüncül Hak Temelli Çerçeve: Yapay zeka, toplumsal fayda hedeflerken insan haklarından ödün vermemeli; yüksek riskli alanlarda kaçınma, düşük riskli alanlarda ise denetimli kullanım benimsenmelidir.

Akılda Tutulması Gerekenler

Yapay Zeka Etiği ve Sorumlu Yaklaşım

- Değer Odaklılık: Teknik verimlilik, insan onuru ve adalet gibi sivil toplum değerlerinin önüne geçmemelidir.

- Etik ve Sorumluluk Farkı: Etik, “ne yapılmalı” sorusuna odaklanan ilkeler bütünüdür; sorumlu YZ ise bu ilkeleri eyleme döken pratiklerdir.

- Meşruiyet: Bir YZ kullanımı, yalnızca teknik olarak mümkün olduğu için değil, etik ilkelere uygunsa meşrudur.

- İnsan Hakları Temeli: Tüm YZ uygulamaları, insan haklarını koruma ve geliştirme perspektifiyle değerlendirilmelidir.

- Zarar Vermeme: Yapay zeka, bireylere veya gruplara yönelik potansiyel zararları en aza indirecek şekilde tasarlanmalı ve kullanılmalıdır.

Algoritmik Önyargı

- Tarihsel Veri Riski: Geçmişteki ayrımcı uygulamaları içeren veriler, YZ tarafından öğrenilerek gelecekteki kararlarda yeniden üretilir.

- Kritik Risk Alanları: Sosyal yardım, işe alım, sağlık ve adalet gibi alanlarda önyargılı sistemler ciddi hak ihlallerine yol açar.

- Temsil Sorunu: Veri setinde yeterince temsil edilmeyen gruplar, YZ kararlarında sistematik olarak dezavantajlı duruma düşebilir.

- Yönetişim Meselesi: Önyargı sadece teknik bir veri sorunu değil, aynı zamanda kurumsal kör noktalar ve güç ilişkileriyle ilgili bir yönetişim sorunudur.

- Tespit Sorumluluğu: Kurumlar, YZ sistemlerini kullanmadan önce ve kullanım sırasında potansiyel önyargıları aktif olarak denetlemelidir.

Açıklanabilirlik ve Kara Kutu Sorunu

- Kara Kutu Nedir: Kararlarının ardındaki mantığı veya işleyişi anlaşılamayan karmaşık YZ sistemleridir.

- Gerekçe Sunma Yükümlülüğü: Özellikle bir bireyin hakkını etkileyen kararlarda (örn. başvuru reddi), sistemin neden bu kararı verdiği açıklanmalıdır.

- İtiraz Hakkının Ön Koşulu: Bir kararın gerekçesi bilinmiyorsa, o karara anlamlı bir şekilde itiraz etmek imkansız hale gelir.

- İzlenebilirlik: Karar süreçlerinin kayıt altına alınması, hem iç denetim hem de dış hesap verebilirlik için zorunludur.

- Meşruiyet ve Açıklama Farkı: Bir çıktının nasıl üretildiğini teknik olarak açıklamak, o kararın etik olarak meşru olduğu anlamına gelmez.

İnsan Denetimi

- Karar Destek Aracı: YZ, bir uzman için veri analizi yapan, öngörü sunan bir yardımcıdır; nihai karar verici değildir.

- Otomasyon Yanlılığı: İnsanların, bir sistemin çıktısını sorgulamadan otomatik olarak doğru kabul etme eğilimi en büyük risklerden biridir.

- Sorumluluk İnsandadır: Bir YZ hatasının sonuçlarından doğacak hukuki ve etik sorumluluk, sistemi denetleyen insana aittir.

- Anlamlı Müdahale: İnsan denetimi, sadece sembolik bir onay değil; kararı durdurma, değiştirme veya reddetme yetkisini içermelidir.

- Yüksek Riskli İşlemler: Hayati kararlar içeren süreçlerde (örn. tıbbi teşhis), zorunlu manuel kontrol mekanizmaları kurulmalıdır.

Veri Gizliliği ve Mahremiyet

- Veri Minimizasyonu: Bir iş için gerekenden fazla kişisel veri toplanmamalıdır; “ne olur ne olmaz” diye veri biriktirmekten kaçınılmalıdır.

- Amaçla Sınılılık: Veri, yalnızca toplandığı belirli ve meşru amaç için kullanılabilir; başka bir amaç için kullanılamaz.

- Hassas Gruplar: Mülteciler, çocuklar, hastalar gibi hassas grupların verileri çok daha yüksek koruma standartları gerektirir.

- Rıza: Kişisel verilerin işlenmesi için alınan rıza, bilgilendirilmiş, özgür ve net bir onaya dayanmalıdır.

- Hak Temelli Tasarım: Gizlilik, sonradan eklenecek bir özellik değil, sistemin en başından itibaren tasarımının bir parçası olmalıdır.

Halüsinasyonlar ve Doğrulama

- Halüsinasyon Nedir: Üretken YZ’nin, istatistiksel kalıplara dayanarak gerçekte var olmayan, uydurma bilgiler üretmesidir.

- Ansiklopedi Değildir: Üretken YZ modelleri birer bilgi tabanı değil, olasılıksal metin üreticileridir; her zaman hata yapabilirler.

- Kurumsal İtibar Riski: Doğrulanmamış YZ çıktılarının raporlarda veya kamu iletişiminde kullanılması, kurumun güvenilirliğine zarar verir.

- Doğrulama Süzgeci: YZ tarafından üretilen her türlü içerik (özellikle rakamlar, isimler, olaylar) mutlaka güvenilir kaynaklardan kontrol edilmelidir.

- Zincirleme Hata: Bir YZ halüsinasyonu, bir sonraki analize veya rapora girdi olarak kullanılırsa, hatalar katlanarak büyür.

Yönetişim ve Politika Oluşturma

- Yazılı Politika Şarttır: YZ’nin hangi amaçlarla, hangi sınırlarda ve kimin onayıyla kullanılacağı net bir politika ile belirlenmelidir.

- Durum Tespiti (Due Diligence): Bir YZ aracı seçilirken, verileri nerede sakladığı, neyle eğitildiği ve güvenlik taahhütleri sorgulanmalıdır.

- Risk Odaklı Yaklaşım: Sadece verimliliğe odaklanır ve olası zararları göz ardı eder.

- Sorumlu Yaklaşım: Verimliliği, haklar, kapsayıcılık ve zarar azaltma ilkeleriyle dengeler.

- Tedarikçi Değerlendirmesi: Kullanılan YZ hizmetini sağlayan şirketlerin etik ve güvenlik standartları, kurumun kendi standartlarıyla uyumlu olmalıdır.

Anahtar Terimler

Algoritmik Önyargı

Yapay zeka sistemlerinin, eğitildikleri verilerde bulunan tarihsel veya sistemsel eşitsizlikleri öğrenerek ayrımcı sonuçlar üretmesi durumu.

Kara Kutu (Black Box)

İç işleyişi veya karar verme mantığı, onu tasarlayanlar tarafından bile tam olarak anlaşılamayan karmaşık yapay zeka sistemlerini tanımlayan bir terim.

İnsan Denetimi (Human-in-the-Loop)

Yapay zeka sistemlerinin karar süreçlerinde nihai yetkinin ve sorumluluğun bir insanda kalması, sistemin sadece bir destek aracı olarak konumlandırılması ilkesi.

Veri Minimizasyonu

Bir görevi yerine getirmek için yalnızca kesinlikle gerekli olan en az miktarda kişisel verinin toplanması, işlenmesi ve saklanması prensibi.

Halüsinasyon

Üretken yapay zeka modellerinin, gerçekte var olmayan, yanlış veya tamamen uydurma bilgileri kendinden emin ve doğru bir şekilde sunması durumu.

Durum Tespiti (Due Diligence)

Bir yapay zeka aracını veya hizmetini kullanmaya başlamadan önce, aracın güvenlik, gizlilik, şeffaflık ve etik standartlarını kapsamlı bir şekilde araştırma ve değerlendirme süreci.

Temel Karşılaştırmalar

Risk Odaklı Yaklaşım vs. Sorumlu Yaklaşım

| Özellik | Risk Odaklı Yaklaşım | Sorumlu Yaklaşım |

|---|---|---|

| Ana Odak | Hız, verimlilik, maliyet düşürme | Haklar, adalet, kapsayıcılık, zarar azaltma |

| Veriye Bakış | İşlenecek bir rakam veya girdi | Arkasında bir insan hayatı olan değerli bilgi |

| Teknolojiye Güven | Yüksek, “hatasız” kabul etme eğilimi | Şüpheci, “karar destek aracı” olarak görme |

| Başarı Ölçütü | Görevi ne kadar hızlı tamamladığı | Görevi etik değerlere uygun ve kimseyi geride bırakmadan tamamladığı |

| Soru | “Bu araç işimizi nasıl hızlandırır?” | “Bu araç herkesi adil bir şekilde temsil ediyor mu?” |

Riskli yaklaşım “Ne kadar hızlı?” diye sorar. Sorumlu yaklaşım ise “Ne kadar adil?” diye sorar.

Sık Yapılan Hatalar

❌ HATA: Yapay zeka çıktısını olduğu gibi kopyalayıp kullanmak.

- Neden olur: Üretken YZ’nin hatasız bir ansiklopedi olduğuna dair yanlış inanç ve zaman kazanma isteği.

- ✅ Doğrusu: YZ tarafından üretilen her bilgiyi, özellikle de rakam, tarih, isim gibi kritik verileri, güvenilir kaynaklardan mutlaka doğrulamak gerekir. YZ bir stajyerdir, uzman değil. Stajyerin işi her zaman kontrol edilir.

❌ HATA: “Daha çok veri daha iyi sonuç demektir” diye düşünmek.

- Neden olur: Verinin niceliğinin niteliğinden daha önemli olduğu varsayımı.

- ✅ Doğrusu: Verinin kalitesi, çeşitliliği ve temsil gücü, miktarından daha önemlidir. Önyargılı milyonlarca veri, adil binlerce veriden daha tehlikelidir.

❌ HATA: Yapay zeka kararını “Sistem böyle karar verdi” diyerek nihai kabul etmek.

- Neden olur: Otomasyon yanlılığı ve karmaşık sistemlerin kararlarını sorgulamaktan çekinme.

- ✅ Doğrusu: Her YZ kararı, özellikle bir bireyi olumsuz etkiliyorsa, bir insan tarafından denetlenmeli ve gerekçelendirilmelidir. Son söz her zaman sorumluluk alabilen bir insanda olmalıdır.

❌ HATA: Bir YZ aracını, veri gizliliği politikasını okumadan kullanmaya başlamak.

- Neden olur: Aracın işlevselliğine odaklanıp arka plandaki veri güvenliği ve mahremiyet risklerini göz ardı etmek.

- ✅ Doğrusu: Bir aracı kullanmadan önce verileri nerede sakladığı, kimlerle paylaştığı ve nasıl koruduğu hakkında durum tespiti yapılmalıdır.

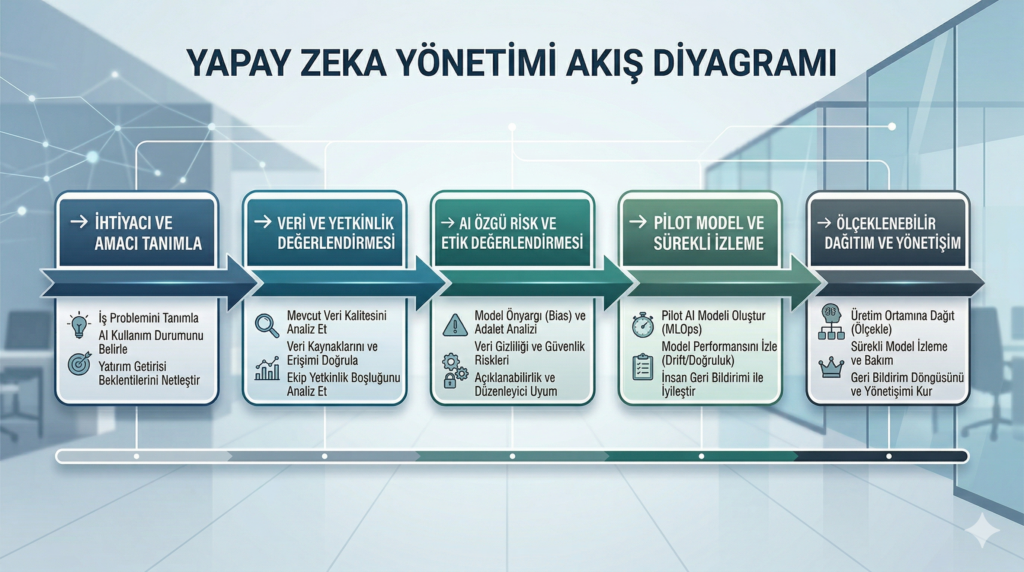

Temel Süreçler

Sorumlu Yapay Zeka Aracı Seçim Süreci

Adım 1: İhtiyacı ve Sınırları Tanımlama

- Ne yapılır: Yapay zekanın hangi sorunu çözmesi hedeflendiği ve bu kullanımın potansiyel risklerinin ne olduğu belirlenir. Yüksek riskli (örn. hak sahipliği belirleme) işler için YZ kullanımından kaçınma kararı bu adımda verilebilir.

- Anahtar gösterge: “Bu işi YZ olmadan yapamaz mıyız?” sorusuna net bir yanıt verilmesi.

Adım 2: Durum Tespiti (Due Diligence)

- Ne yapılır: Potansiyel YZ araçlarının veya hizmet sağlayıcılarının gizlilik politikaları, veri güvenlik standartları, şeffaflık beyanları ve önyargı azaltma taahhütleri incelenir.

- Anahtar gösterge: Tedarikçiye “Verilerimizi nerede ve nasıl saklıyorsunuz? Modeliniz hangi verilerle eğitildi?” gibi soruların sorulması.

Adım 3: Risk Değerlendirmesi ve Azaltma

- Ne yapılır: Seçilen aracın kullanımıyla ortaya çıkabilecek önyargı, mahremiyet ihlali, şeffaflık eksikliği gibi riskler değerlendirilir. Bu riskleri azaltmak için insan denetimi, ek doğrulama adımları gibi mekanizmalar planlanır.

- Anahtar gösterge: Her potansiyel risk için bir “azaltma stratejisi” belirlenmesi.

Adım 4: Kademeli Uygulama ve İzleme

- Ne yapılır: Araç, önce küçük bir pilot projede, sınırlı bir veri setiyle test edilir. Sonuçlar sürekli izlenir, beklenmedik hatalar veya önyargılar raporlanır ve sistem performansı düzenli olarak değerlendirilir.

- Anahtar gösterge: Pilot uygulama sonuçlarını değerlendiren bir raporun hazırlanması.

AKIŞ:

→ İhtiyacı Tanımla

→ Durum Tespiti Yap

→ Riskleri Değerlendir

→ Kademeli Uygula ve İzle

→ Tam Entegrasyon

BELGE SONU

Bu rehber, Claude Opus 4.6 ve Google Gemini 3 ile hazırlanmıştır. Görseller NanoBanana ve Flux.2 Pro le üretilmiştir.